Google Gemini: Tutto ciò che devi sapere sulla nuova piattaforma di intelligenza artificiale generativa

Google sta cercando di fare scalpore con Gemini, la sua suite principale di modelli, app e servizi di intelligenza artificiale generativa.

Allora, cos'è Gemini? Come puoi usarlo? E come si confronta con la concorrenza?

Per rendere più facile seguire gli ultimi sviluppi di Gemini, abbiamo preparato questa pratica guida, che manterremo aggiornata man mano che vengono rilasciati nuovi modelli, funzionalità e notizie sui piani di Google per Gemini.

Cos'è Gemini?

Gemini è la nuova famiglia di modelli GenAI di prossima generazione di Google, sviluppata dai laboratori di ricerca sull'intelligenza artificiale DeepMind e Google Research. Viene proposto in tre varianti:

- Gemini Ultra, il modello Gemini più performante.

- Gemini Pro, un modello Gemini “lite”.

- Gemini Nano, un modello “distillato” più piccolo che funziona su dispositivi mobili come il Pixel 8 Pro.

Tutti i modelli Gemini sono stati addestrati per essere “nativamente multimodali” - in altre parole, in grado di lavorare con più di solo parole. Sono stati preaddestrati e ottimizzati su una varietà di audio, immagini e video, un ampio set di codici e testi in diverse lingue.

Questo differenzia Gemini da modelli come il LaMDA di Google, che è stato addestrato esclusivamente su dati testuali. LaMDA non riesce a capire o generare nulla oltre al testo (ad esempio, saggi, bozze di email), ma non è questo il caso dei modelli Gemini.

In cosa differiscono le app Gemini dai modelli Gemini?

Google, dimostrando ancora una volta di non avere una propensione per il branding, non ha reso chiaro fin dall'inizio che Gemini è separato e distinto dalle app Gemini sul web e su dispositivi mobili (precedentemente Bard). Le app Gemini sono semplicemente un'interfaccia attraverso la quale è possibile accedere a determinati modelli Gemini - pensa a esse come a un client per il GenAI di Google.

Le app e i modelli Gemini sono anche del tutto indipendenti da Imagen 2, il modello di testo-immagine di Google disponibile in alcune delle sue strumenti e ambienti di sviluppo.

Cosa può fare Gemini?

Poiché i modelli Gemini sono multimodali, possono in teoria svolgere una serie di compiti multimodali, dalla trascrizione del discorso alla didascalia di immagini e video alla generazione di opere d'arte. Alcune di queste capacità devono ancora raggiungere lo stadio del prodotto (ne parleremo più avanti), ma Google promette tutte loro — e altro ancora — in un futuro non troppo lontano.

Naturalmente, è un po' difficile credere alla parola dell'azienda.

Google ha deluso gravemente con il lancio originale di Bard. E più di recente ha infastidito con un video che sosteneva di mostrare le capacità di Gemini e che si è rivelato essere pesantemente manomesso e aspirazionale.

La migliore dimostrazione di Gemini di Google era falsa

Ancora, assumendo che Google stia dicendo più o meno la verità con le sue affermazioni, ecco cosa saranno in grado di fare i diversi livelli di Gemini una volta raggiunto il loro pieno potenziale:

Gemini Ultra

Google dice che Gemini Ultra - grazie alla sua multimodalità - può essere utilizzato per aiutare con cose come i compiti di fisica, risolvere i problemi passo dopo passo su un foglio di lavoro e individuare possibili errori nelle risposte già compilata.

Gemini Ultra può anche essere utilizzato per compiti come identificare articoli scientifici rilevanti per un determinato problema, estrarre informazioni da quegli articoli e “aggiornare” un grafico di uno di essi generando le formule necessarie per ricreare il grafico con dati più recenti.

Tecnicamente, Gemini Ultra supporta la generazione di immagini, come accennato in precedenza. Ma questa capacità non è ancora presente nella versione del modello pronti per l'uso come prodotto - forse perché il meccanismo è più complesso di come le app come ChatGPT generano le immagini. Piuttosto che alimentare prompt a un generatore di immagini (come DALL-E 3, nel caso di ChatGPT), Gemini produce immagini “nativamente”, senza uno step intermedio.

Gemini Ultra è disponibile come API attraverso Vertex AI, la piattaforma di sviluppo di intelligenza artificiale completamente gestita di Google, e AI Studio, lo strumento basato sul web per sviluppatori di app e piattaforme. Alimenta anche le app Gemini - ma non gratuitamente. L'accesso a Gemini Ultra tramite quello che Google chiama Gemini Advanced richiede l'iscrizione al piano Google One AI Premium, al prezzo di $20 al mese.

Il piano AI Premium connette inoltre Gemini al tuo account Google Workspace più ampio - pensa alle email in Gmail, ai documenti in Documenti, alle presentazioni in Fogli e alle registrazioni di Google Meet. Questo è utile, ad esempio, per riassumere le email o far catturare a Gemini appunti durante una videochiamata.

Gemini Pro

Google dice che Gemini Pro è un miglioramento rispetto a LaMDA nelle sue capacità di ragionamento, pianificazione e comprensione.

Uno studio indipendente condotto da ricercatori di Carnegie Mellon e BerriAI ha scoperto che la versione iniziale di Gemini Pro era effettivamente migliore di GPT-3.5 di OpenAI nel gestire catene di ragionamento più lunghe e complesse. Ma lo studio ha anche rilevato che, come tutti i grandi modelli di lingua, questa versione di Gemini Pro ha particolarmente faticato con problemi matematici che coinvolgono diversi numeri, e gli utenti hanno trovato esempi di cattivo ragionamento e errori evidenti.

Le prime impressioni su Gemini di Google non sono eccezionali

Google ha promesso rimedi, tuttavia - e il primo è arrivato sotto forma di Gemini 1.5 Pro.

Pensato per essere una soluzione sostitutiva, Gemini 1.5 Pro è migliorato in vari ambiti rispetto al suo predecessore, forse più significativamente nella quantità di dati che può elaborare. Gemini 1.5 Pro può gestire ~700.000 parole, o ~30.000 righe di codice - 35 volte la quantità che Gemini 1.0 Pro può gestire. E - essendo il modello multimodale - non è limitato al testo. Gemini 1.5 Pro può analizzare fino a 11 ore di audio o un'ora di video in una varietà di lingue diverse, sebbene lentamente (ad esempio, la ricerca di una scena in un video di un'ora richiede da 30 secondi a un minuto di elaborazione).

Gemini 1.5 Pro è entrato in anteprima pubblica su Vertex AI in aprile.

Un endpoint aggiuntivo, Gemini Pro Vision, può elaborare testo e immagini - comprese foto e video - e generare testo simile al modello GPT-4 con Vision di OpenAI.

All'interno di Vertex AI, gli sviluppatori possono personalizzare Gemini Pro per contesti e casi d'uso specifici utilizzando un processo di ottimizzazione o “grounding”. Gemini Pro può anche essere collegato a API esterne di terze parti per eseguire azioni particolari.

Google porta Gemini Pro su Vertex AI

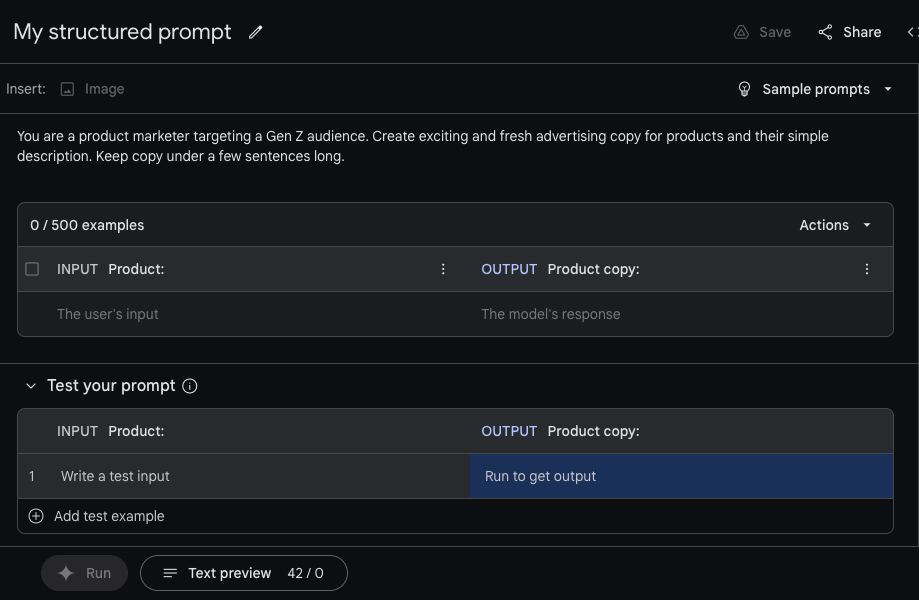

In AI Studio, ci sono flussi di lavoro per creare prompt di chat strutturati utilizzando Gemini Pro. Gli sviluppatori hanno accesso sia a Gemini Pro che agli endpoint Gemini Pro Vision, e possono regolare la temperatura del modello per controllare la gamma creativa dell'output e fornire esempi per dare istruzioni su tono e stile - e anche regolare le impostazioni di sicurezza.

Gemini Nano

Gemini Nano è una versione molto più piccola dei modelli Gemini Pro e Ultra, ed è abbastanza efficiente da funzionare direttamente su (alcuni) telefoni anziché inviare il compito a un server da qualche parte. Finora alimenta un paio di funzionalità su Pixel 8 Pro, Pixel 8 e Samsung Galaxy S24, tra cui Sommario in Registratore e Risposta Intelligente in Gboard.

L'app Registratore, che consente agli utenti di premere un pulsante per registrare e trascrivere audio, include un riassunto dei tuoi dialoghi, interviste, presentazioni e altri snippet registrati alimentato da Gemini. Gli utenti ottengono questi riassunti anche se non hanno una connessione disponibile a Internet o Wi-Fi - e in un omaggio alla privacy, nessun dato lascia il loro telefono nel processo.

Gemini Nano è anche presente in Gboard, l'app di tastiera di Google. Lì, alimenta una funzione chiamata Risposta Intelligente, che aiuta a suggerire cosa dire dopo in una conversazione in un'app di messaggistica. Inizialmente la funzionalità funziona solo con WhatsApp ma arriverà su più app nel tempo, dice Google.

E nell'app Messaggi di Google su dispositivi supportati, Nano abilita Composizione Magica, che può comporre messaggi in stili come “eccitato”, “formale” e “lirico”.

È Gemini migliore di GPT-4 di OpenAI?

Google ha più volte vantato la superiorità di Gemini su vari benchmark, affermando che Gemini Ultra supera i risultati attuali di punta su “30 dei 32 benchmark accademici ampiamente utilizzati nella ricerca e nello sviluppo di grandi modelli di lingua”. L'azienda afferma che Gemini 1.5 Pro, nel frattempo, è più capace in compiti come il riassunto dei contenuti, il brainstorming e la scrittura rispetto a Gemini Ultra in alcuni scenari; presumibilmente ciò cambierà con il rilascio del prossimo modello Ultra.

Ma lasciando da parte la questione se i benchmark indichino realmente un modello migliore, i punteggi a cui Google si riferisce sembrano essere solo marginalmente migliori rispetto ai modelli corrispondenti di OpenAI. E - come accennato in precedenza - alcune prime impressioni non sono stati ottime, con utenti e accademici che hanno evidenziato che la vecchia versione di Gemini Pro tende a sbagliare fatti di base, fatica con le traduzioni e fornisce suggerimenti di codifica scadenti.

Quanto costa Gemini?

Gemini 1.5 Pro è gratuito da utilizzare nelle app Gemini e, per il momento, in AI Studio e Vertex AI.

Una volta che Gemini 1.5 Pro uscirà dall'anteprima in Vertex, tuttavia, il modello costerà $0,0025 per carattere mentre l'output costerà $0,00005 per carattere. I clienti di Vertex pagano per 1.000 caratteri (circa 140-250 parole) e, nel caso di modelli come Gemini Pro Vision, per immagine ($0.0025).

Supponiamo che un articolo di 500 parole contenga 2.000 caratteri. Riassumere tale articolo con Gemini 1.5 Pro costerebbe $5. Nel frattempo, generare un articolo di lunghezza simile costerebbe $0,1.

Il prezzo per Ultra deve ancora essere annunciato.

Dove puoi provare Gemini?

Gemini Pro

Il modo più semplice per sperimentare Gemini Pro è nelle app Gemini. Pro e Ultra rispondono a domande in una gamma di lingue.

Gemini Pro e Ultra sono anche accessibili in anteprima in Vertex AI tramite un'API. L'API è gratuita da utilizzare “entro certi limiti” per il momento e supporta determinate regioni, inclusa l'Europa, nonché funzionalità come la funzionalità di chat e il filtraggio.

In altri contesti, Gemini Pro e Ultra possono essere trovati in AI Studio. Utilizzando il servizio, gli sviluppatori possono iterare prompt e chatbot basati su Gemini e quindi ottenere chiavi API per usarli nelle loro app - o esportare il codice in un ambiente di sviluppo più completo.

Code Assist (precedentemente Duet AI per sviluppatori), la suite di strumenti di assistenza alimentati da intelligenza artificiale di Google per il completamento e la generazione di codice, sta utilizzando modelli Gemini. Gli sviluppatori possono eseguire “cambiamenti su larga scala” attraverso i codici, ad esempio aggiornando le dipendenze cross-file e verificando ampi pezzi di codice.

Google ha portato i modelli Gemini nei suoi strumenti di sviluppo per Chrome e la piattaforma di sviluppo mobile di Firebase, e nei suoi strumenti di creazione e gestione del database. E ha lanciato nuovi prodotti di sicurezza supportati da Gemini, come Gemini in Threat Intelligence, un componente della piattaforma di sicurezza informatica di Google Mandiant che può analizzare ampie porzioni di codice potenzialmente dannoso e consentire agli utenti di eseguire ricerche in linguaggio naturale per minacce in corso o indicatori di compromissione.

Gemini Nano

Gemini Nano è presente su Pixel 8 Pro, Pixel 8 e Samsung Galaxy S24 - e arriverà su altri dispositivi in futuro. Gli sviluppatori interessati ad incorporare il modello nelle loro app Android possono registrarsi per un'anteprima esclusiva.

Arriverà Gemini sull'iPhone?

Potrebbe essere! Apple e Google sarebbero in trattative per utilizzare Gemini per una serie di funzionalità da includere in un prossimo aggiornamento di iOS entro la fine dell'anno. Niente è definitivo, poiché Apple sarebbe anche in trattative con OpenAI e sarebbe impegnata nello sviluppo delle proprie capacità GenAI.

Questo post è stato originariamente pubblicato il 16 febbraio 2024 e da allora è stato aggiornato per includere nuove informazioni su Gemini e i piani di Google per esso.